Az Apple ismét közzétett egy cikket gépi tanulással foglalkozó blogján. Az Apple Machine Learning Journal legutóbbi cikke azokat a módszereket részletezi, amelyeket a HomePod használ távolabbi vagy zajos környezetben lévő beszélők hangjának felismerésére és kiszűrésére.

A főként programozókat, matematikusokat, adatelemzőket célzó írás részletekbe menően elemzi a cég audió- és beszédfelismerés csapatának mérnökei által kifejlesztett algoritmusokat. Az iDownloadBlog cikke azonban röviden összefoglalja a lényeget.

Long story short, Siri on HomePod implements the Multichannel Echo Cancellation (MCEC) algorithm which uses a set of linear adaptive filters to model the multiple acoustic paths between the loudspeakers and the microphones to cancel the acoustic coupling.

Azaz:

A HomePodon futó Siri lényegében az MCEC, azaz többcsatornás visszhangszűrés algoritmust futtatja. Ez lineáris adaptív szűrőket használ arra, hogy a HomePod hangszóróiból érkező nemkívánatos visszhangot leválassza a mikrofonok jeléről.

Az MCEC egy ismert technika a digitális jelfeldolgozásban. A HomePod azonban nem csak ezt használja, mivel ez az Apple cikke alapján közel sem tökéletes:

Two problems limit the MCEC from completely removing the device’s own playback signal from the microphones in practice:

- Nonlinear coupling. Due to loudspeaker nonlinearity and mechanical vibrations of the devices, the entirety of the playback signal isn’t captured by the linear system model [8].

- Non-unique solutions. When multichannel content is playing from the beamforming speaker array, the solution can be non-unique [9].

Magyarul:

A gyakorlatban azonban két probléma megakadályozza, hogy az MCEC teljesen kiszűrje a készülék által lejátszott zenét a mikrofonok jeléből:

- Nemlineáris csatolás. A hangszórók nemlineáris viselkedése és mechanikai rezgésük miatt a lineáris modell nem képes teljesen leírni a belőlük jövő hangot.

- Nem egyértelmű megoldások. Amikor több csatornán szól a zene, a modellnek több megoldása is lehet (és nem biztos, hogy pont a fizikailag ténylegesen megvalósuló megoldás fog kijönni – a szerk.)

Emiatt az Apple mérnökei kifejlesztették a saját utószűrő rendszereiket, amelyek valós időben optimalizálják a saját paramétereiket statisztika és gépi tanulás segítségével. Az egyik módszerük például az egyes hangsávok statisztikai értelmben vett “függetlenségét” (statisztikusok itt hunyják be a szemüket!) használja ki, hogy elkülönítse a beszélő hangját a háttérzajtól.

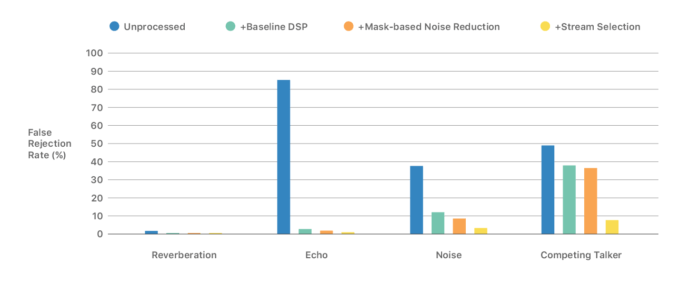

A HomePod algoritmusainak hatékonyságát meghallgatható hangmintákkal is bizonyítják, illetve a”Hey, Siri!” felkiáltás felismerésének hibáját is ábrázolták egy grafikonon. Ebből például látható, hogy amikor ketten beszélnek párhuzamosan, a házi fejlesztésű jelfeldolgozó algoritmusok 38%-ról körülbelül 8%-ra csökkentik a hibaarányt:

Aki részletesebben is érdeklődik a két fő algoritmus technikai háttere iránt, az érdekes olvasnivalónak találhatja a teljes, eredeti cikket.

[newsletter_signup_form id=11]

Szólj hozzá: Hozzászólok