Szerdán az Apple közzétett három cikket, amelyben a Siri fejlesztőcsapata leírja, hogy milyen új módszerekkel tették a virtuális asszisztenst még természetesebben hangzóvá és gördülékenyebben használhatóvá, és hogyan tanították meg egyre pontosabb hangfelismerésre.

Az Apple Machine Learning Journalban, a cég néhány hete létrehozott, gépi tanulásról szóló online folyóiratában megjelent írások mindegyike Siri felasználói felületének egy-egy kiemelten fontos aspektusába kínál betekintést.

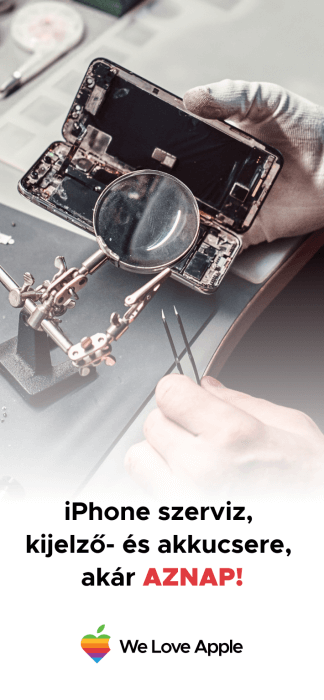

Az első cikk a beszédszintézisről (TTS, Text-to-Speech) szól, egészen pontosan arról, hogy a Siri hangját megvalósító program egy központi fontosságú részét lecserélték. A felvett emberi hangmintákból a megfelelő hangrészleteket, hangokat, szótagokat kiválogató és összeállító, úgynevezett unit selection (egységkiválasztó) algoritmusban iOS 10-től kezdve a hagyományos statisztikai eljárások helyett korszerűbb, mélytanuláson (deep learning) alapuló módszert alkalmaznak. A cikk végén szerepel, hogy egy A/B teszt alapján az iOS 10-es hangot az emberek jelentős része szubjektíven szebbnek, kellemesebbnek tartja, mint az iOS 9-ben szereplőt. A legnagyobb különbséget az orosz nyelvű női hang esetén figyelhetjük meg: itt a hallgatók több mint 80 százaléka részesítette előnyben Siri iOS 10-beli hangját.

(Kattints a képre, és görgess le a hangokhoz, tesztelheted, hogy milyen lesz az iOS 11 Sirije.)

A második írás az inverz szövegnormalizálás problémáját járja körül. Ennek lényege, hogy a Siri által megfogalmazott válaszokat hogyan lehet írásban minél szebben megformázni. A cikk a dátumok, mennyiségek és címek példáját hozza fel: a kérdező számára nyilván jobban olvasható, ha az írott válaszban “augusztus 26., 8:25” szerepel, mintha a fölöslegesen terjengős “augusztus huszonhatodika, nyolc óra huszonöt perc” szöveget jelenítené meg a készülék. Ezt a feladatot az Apple mérnökei egy úgynevezett címkézési problémaként fogalmazták meg, amelynek során minden egyes szövegelem (például teljes szavak, mértékegységek és pénznemek jelei, vagy rövidítések) kap egy, a szövegben betöltött szerepének, szemantikájának megfelelő címkét, mint például: “sorszám”, “tulajdonnév” vagy “szorzótényező”. Ennek segítségével ismét lehetővé válik a gépi tanulás alkalmazása. Az algoritmust megvalósító mesterséges neuronhálót ötmillió, előre felcímkézett válaszból álló halmazon taníttatták a fejlesztők, aminek eredményeként Sirinek az esetek 99,85 százalékában sikerült helyesen leírnia a generált beszédet.

A harmadik cikk Siri talán legérzékenyebb, legproblémásabb pontját érinti: a beszédfelismerést. Legyünk őszinték: a géptitkárnő beszélgetőpartnerei zavaróan sokszor találhatják magukat abban a kellemetlen helyzetben, hogy Siri részben vagy teljesen félreérti a mondandójukat. (Persze ennek megvan a napos oldala is: sok humor forrását jelentik a kicsavartan, többértelműen megfogalmazott, vagy az adott élethelyzetbe véletlenül, viccesen beleillő, félrecsúszott válaszok.) Ennek javítására is dolgoztak ki új, gépi tanulási módszereket az almás cég szakértői. Rájöttek, hogy a különböző nyelvek felismerésére betanított mesterséges neuronhálózatok nagy része (a belső, úgynevezett rejtett rétegek) szinte azonosak, a nyelvektől függetlenek. Úgy gondolták, hogy ennek az oka az, hogy a belsőbb rétegek olyan általános, magasabb szintű jellegzetességeket tanulnak meg felismerni, amelyek minden emberi nyelvben léteznek és hasonlítanak. Ennek a megfigyelésnek az eredményeképpen sikerrel tudtak újrahasznosítani már meglévő neuronháló-részeket új nyelvek felismerésére való, jelentősen gyorsabb és kevesebb adatot igénylő betanítására.

Bár a cikkek tudományos nyelvezetűek, mégis nagyon lényegre törően, tömören, jól érthetően megfogalmazva mutatják be a kihívásokat és a Siri fejlesztőcsapatának a felmerülő problémákra adott megoldásait. A szerzők nem alkalmaznak a feladatok és módszerek pontos leírásához szükségesnél bonyolultabb kifejezéseket, és javarészt klasszikus, közismert statisztikus módszerekre és fogalmakra (például Vitebri-keresés, Kullback–Leibler-divergencia) hivatkoznak. Bár e sorok írója csak alapszintű bioinformatikai képzésből származó statisztikai és valószínűségszámítási ismeretekkel rendelkezik, mégsem okozott számára problémát a fejlesztések lényegének megértése.

Függetlenül azonban attól, hogy kit mennyire foglalkoztat a mögöttes technológia, abban biztosak lehetünk, hogy Siri képességei sokat javultak az elmúlt években, és a jövőre nézve ez egyre inkább igaz lesz.

[newsletter_signup_form id=2]

14 Comments

Vicces, hogy a Magyarosi Csaba pont most ecsetelte, hogy a siri lof@szt fejlődött az utóbbi 5 évben…és hát tényleg.

@Sanyy: úgy érted, az Apple hazudik, és meghallgattad a linkelt oldal alján a hangmintákat, de szintén nincs különbség köztük?

@Jadeye: sztem pont úgy értette hogy javult, csak éppen MCS nem vette észre.

Magyarosi egy P@cs.. Idegesítő hangnemben beszél, kb 5 másodpecenkét megvágja a videóit és ez olyan idegesítő hangnemet eredmégyez, minta mindig ordítana. Hiába van targalom a mindanivalója mögött, nem lehet végignézni… Bár ez csak az én véleményem!! Másik, ha nem a sirit nézzük, akkor a magyar felolvaso, az az ios 6ota el van baszarintva, ios 6-ban tök jól, érthetően felolvasta a szövegeket.. Ios7 ben vettem észre, h iszonyatosan sz.. inkább azt írom le, hogy rossz! Vezetés közben mindig felolvastattam a kedven cikkeimet, Ios7 ota felesleges használni.. Probáltam a jobb minőséget is használni, de az sem hozott számottevő változást… Létezik külön app felolvasota?

Felolvasora? ????

Nagyon király hogy így fejlesztik a sirit csak kár hogy sz@rnak a magyarok fejére és b@sznak magyarositani de amúgy nagyon szép meg jó csak nekünk használhatatlan…. gondolom még a 11-ben sem lesz magyar

Évek óta használom a Siri-t zene felismerésre a “What’s playing?” paranccsal. Na annyit sikerült fejleszteniük sirin, hogy most már időnként ahelyett, hogy meghallgatná a zenét elkezd ő zenét lejátszani, és ilyenkor ha 10x kérem meg rá akkor 10x elindít egy zenét…. Na ilyenkor elszoktam küldeni a teremtőjébe…..

iOS 11-ben lecserélték a szinésznőt? iOS9 és iOS10 között érezhető a különbség, bár ízlés dolga, nekem a kicsit gépies hang jobban megfelelt, de úgysem hallgatom sűrűn. iOS10 és iOS11 között ilyen drasztikus változtatást nem hallok, csak fiatalabbnak tűnik a hang.

Inkább már annyit fejlődne hogy tudná a magyar nyelvet!!!!

nem hiszem hogy magyarul fog beszélni valaha. pont annak a 1-2 millió magyarnak meg kb 500 ezernek aki használná fog az apple magyar sirit fejleszteni…

Itt van egy jó összehasonlító videó a ma elérhető digitális asszisztensekről: https://www.youtube.com/watch?v=BkpAro4zIwU

Azért látszik, hogy van még hová fejlődnie (kontextus megőrzése terén), de alapjában véve elég használható Siri.

Hat akkor meg be kaphatja az Apple mert akkor az ide szánt példányokban egyáltalán minek foglalja a helyet?

@Nrbrtbgg: nem foglal annyit, amivel jelentősen több helyed lenne. angolul és több egyéb nyelven is használhatod.

Ja,sokat változott .Magyarul vajon mikor beszél ,hány év múlva ….